自動運転のもうひとつの要:AIを使った音声アシスタント

ニュース

ビジネス

このドライブアシスタンス機能は、ニュアンス・コミュニケーションズ(ニュアンス)が開発した「Dragon Drive」という音声合成・音声認識エンジンによって実現されている。同社は、音声合成・音声認識技術は、これからの自動運転カーやコネクテッドカーには欠かせないものだとして、開発を進めている。

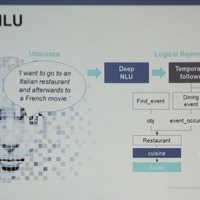

平均的なカーナビにもルート設定に音声認識が対応しているモデルは珍しくない。しかし、これらは登録された地名や単語のみを解釈しているものが多い。同社が目指すシステムは、ドライバーと対話しながら、必要な情報を認識し、ドライバーがしたいタスクをこなすような音声認識だ。つまり、「目的地設定」のようなコマンド的な発話と対応する地名・施設名の発話を認識して、ルートを設定するのではなく、「〇〇周辺のレストラン」といえば、AIがレストランの種類(フレンチ、和食、その他)を対話で聞き出し、必要なら予約もいれる。「近くに駐車場はあるか?」といえば、現在位置近くの駐車場ではなく、レストラン近くの駐車場を探すことができるようなシステムだ。

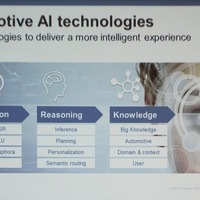

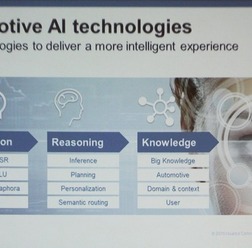

これを実現させるため、同社では「Interaction」「Reasoning」「Big-Knowledge」の3つを重要なAI技術として研究しているという。

Interactionは、AIとの対話インターフェイスを提供する。要素技術は、音声認識(ASR)、自然言語認識(NLU)、前方照応(省略・代名詞の解釈)、自然言語合成(NLG)となる。これらの技術を組み合わせることで、コマンドシーケンスを音声入力してもらうだけのAIから、自然な対話から必要な指示や命令を認識できるAIになることができる。

Reasoning(理由付け)では、推論、行動や処理計画、意味の分類を行うことで、解読した命令が、ルート検索なのか、メール送信なのか、店の予約なのか、などのタスクをこなす機能を実現する。一連の対話の中にはタスクが複数含まれることもあるが、これも処理できなければならない。

Big-Knowledgeは、タスクをこなすためクラウドやオープンサービスの情報を利用することだ。必要ならば、個別に蓄積されたライフログ情報(よく行く場所、よく使うルートとその時間、行動パターン)も利用して、より高度なAI体験を実現する。

以上の技術によって、ドライバーは運転中にしたいタスクを対話によってAIに指示することができるようになる。スマホやカーナビを手で操作する必要もなく、視線も運転に集中できる。非常に便利だが、これらは自動運転が実現すれば必要ないのでは、と考えるかもしれない。

しかし、自動運転支援カー、自動運転カーに必要とされる機能に、車の状態、AIの認識状況をドライバーに的確に伝えるというものがある。パイロット交代の「I have control.」「You have control.」のようなやりとりで制御切り替えを明確にするプロトコルのようなものだ。

対向車、後方からの車を認識しているのか、自動運転区間内なのか、終了するのか、といった情報をドライバーに認識させる機能は、完全無人カー以外では重要なインターフェイスといえる。これらを伝えるため、メーターパネル、ステアリング、ヘッドアップディスプレイの表示を各社が工夫している。ここに音声ガイダンス、AIとの対話機能の活用場面が生まれる。

そのためには、ニュアンスが研究しているような高度な音声認識AIが不可欠となる。

《中尾真二》

この記事の写真

/